最近、X(旧Twitter)のGrokをはじめとするAI機能によって、アップロードした写真やイラストが意図せず改変されてしまうケースが増えています。ワンタップで人物の服装が変わったり意図しない姿に加工されてしまったり。技術の進歩といえば聞こえはいいですが、作り手や被写体からすれば、たまったものではありません。

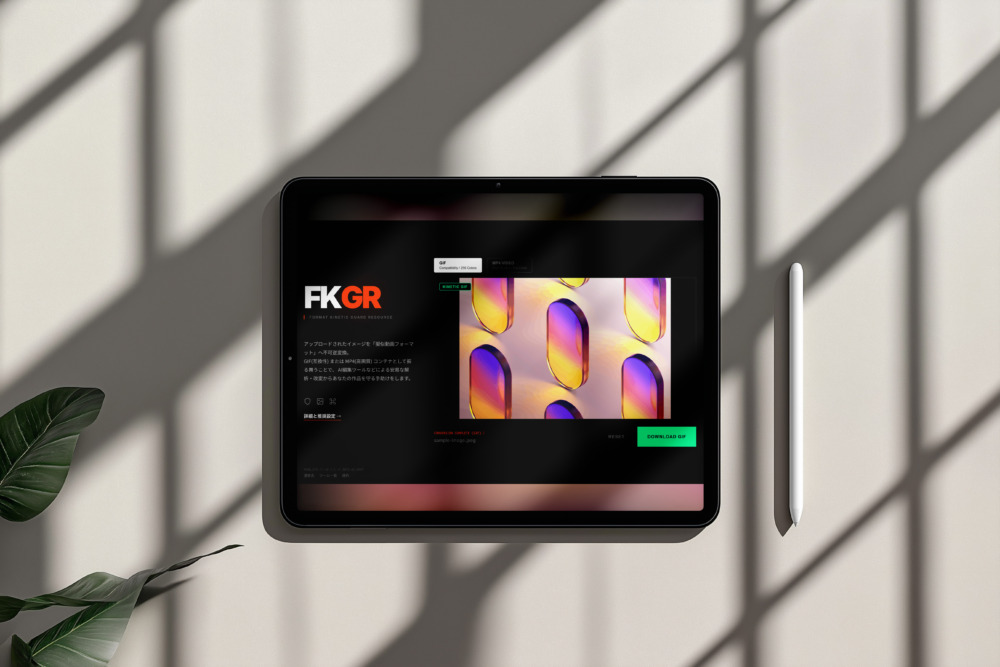

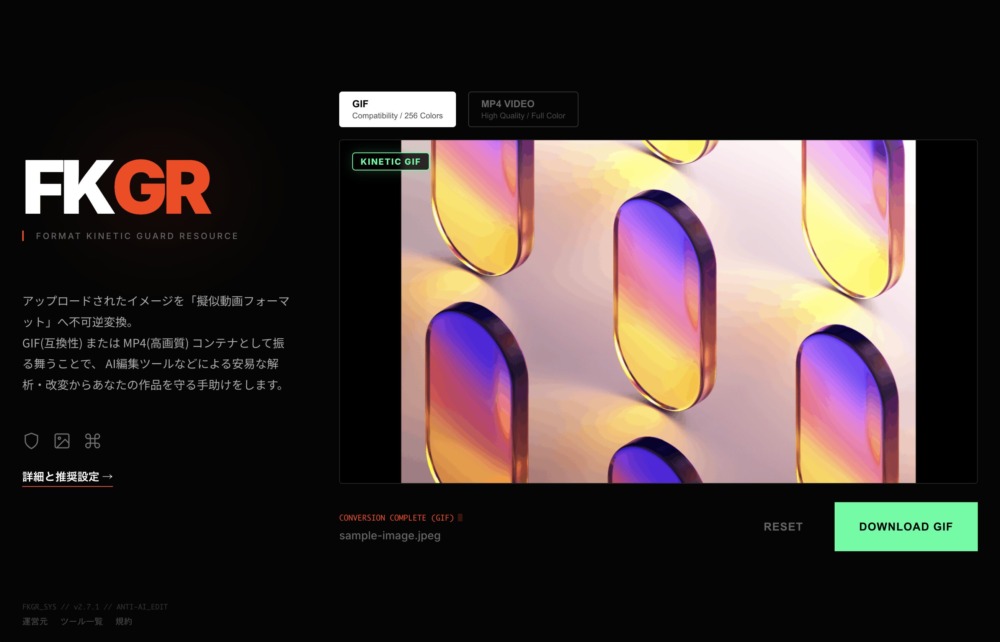

「怖くて作品を上げられない」 そんな声も耳にします。そこで、現状のシステムにおける「安易な改変」を防ぐためのツール「FKGR(Format Kinetic Guard Resource – 形式動態化によるリソース保護)」を開発しました。

「動画に見せかけた静止画」でスルーさせる

このツールの仕組みは、アップロードされた画像を「見た目は静止画のまま、データ形式だけ動画(MP4/GIF)」に変換するというものです。

多くの生成AIや画像編集機能は、静止画(JPG/PNGなど)に対しては即座に解析や編集ボタンを表示しますが、動画ファイルに対しては処理をスルーしたり、編集の手順が複雑になったりする傾向があります。このツールはそのシステム的な挙動の違いを利用しています。画像を動画コンテナに包むことで、AI側に「これは編集対象の画像ではありませんよ」と認識させ、ワンタップでの安易な改変を防ぐことが狙いです。

用途に合わせて、画質劣化の少ない「MP4モード(PC推奨)」と、互換性の高い「GIFモード」を選べるようにしています。

正直な話、「上げない」のが最強の対策です

ここで誤解のないようにはっきりと言っておきたいことがあります。このツールは、画像をAIから完全に守る「絶対安全な盾」ではありません。

抜け道はいくらでもあります。スクリーンショットを撮られればまた画像として処理されますし、AI側のアップデートで動画もシームレスに編集できるようになれば、この方法は通用しなくなります。そもそもデジタルデータとして公開する以上、コピーや加工のリスクをゼロにすることは不可能です。

究極的なことを言えば「ネットに上げない」ことこそが、最も確実な安全対策です。これに勝る防御はありません。

それでも、表現の場を失いたくないから

「上げないのが一番安全」。それは分かっています。でも、それではクリエイターは作品を誰にも見てもらえなくなってしまいます。リスクを恐れて活動を止めてしまうのは、あまりにも悲しい。

だからこそ「完璧ではないけれど、ハードルを上げる」ことに意味があると考えました。鍵のかかっていないドアでも、ロープを張って「立入禁止」と書いておけば、うっかり入ってくる人は防げます。このツールがやっているのはそういうことです。

システムによる機械的な自動改変や悪意のないユーザーによる「なんとなくの加工」を防ぐ。それだけでも、無防備に画像を放流するよりはずっとマシなはずです。

AIと共に作り、AIに抗う

このツールには皮肉な側面があります。それは「AIの力を借りて開発した」ということ。僕はバリバリのエンジニアではありません。あくまでデザイナーです。僕がとった手法は「バイブコーディング」と呼ばれるもの。GeminiというAIと対話し、あーだこーだと指示を出しながらコードを書かせ、デザインを整えていくスタイルです。

毒を以て毒を制す、あるいは敵の武器を奪ってバリケードを築くような感覚があります。AIが生成したコードが、AIの侵入を防ぐ壁になる。AIを便利な道具として使いこなしつつ、守るべき領域にはしっかりと線を引く。

FKGRは万能なセキュリティツールではありません。あくまで現状のAI機能の隙間を突いた、ちょっとしたバリケードです。

それでも 「自分の作品を安易に素材として扱われたくない」「ワンタップで変えられるのは我慢ならない」 そう感じる方にとって、意思表示を含めた一つの選択肢になれば幸いです。